过去一年,本地大模型和国产模型在国内发展得非常快。除了常见的通义千问、Kimi 之外,

不少工程师开始认真研究DeepSeek这一类专注代码与推理能力的模型。

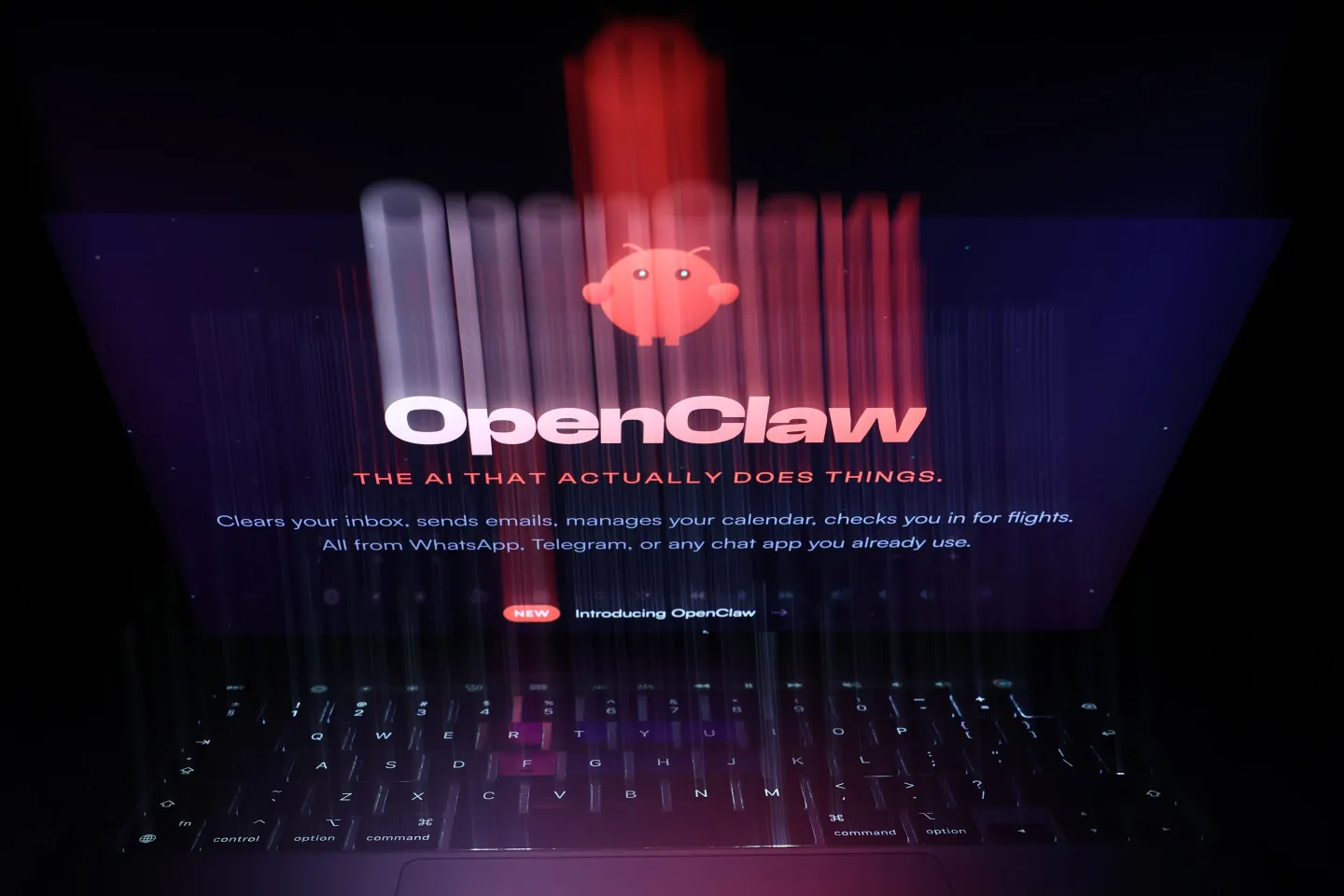

与此同时,OpenClaw作为“养龙虾”派系里的代表,本身又是一个对模型极度友好的Agent框架。

很自然的问题就来了:能不能让 OpenClaw用上 DeepSeek,当一只真正“懂中文、懂代码、跑在身边”的龙虾?

本文不是那种只停留在“看起来能用”的截图教程,而是结合实际踩坑,尽量还原你在把DeepSeek接入 OpenClaw过程中会遇到的细节。

我们会覆盖从API选择、代理配置、本地部署、到在对话中充分发挥DeepSeek推理优势的完整链路。

Contents

一、为什么要让 OpenClaw用 DeepSeek?

1. 国内访问体验更友好

虽然 OpenClaw天生支持 OpenAI、Anthropic 等海外服务,但在国内网络环境下长期稳定使用,往往还要和代理、限流、账单打持久战。

相比之下,接入DeepSeek这种已经针对中文场景做过优化的模型,可以显著降低网络和合规层面的摩擦。

对很多公司来说,“模型在国内、数据可控” 是能不能把 OpenClaw引入生产环境的一道硬门槛。

能通过DeepSeek这样的模型完成前期 PoC,再逐步推进到内部落地,会比一上来就全押海外模型安全得多。

2. 代码与推理场景的优势明显

DeepSeek 在社区里被频繁提及的一个原因,是它在代码生成与问题推理上的表现。

对于一只每天要帮你读代码、查 Bug、改脚本的“龙虾”来说,

这类能力直接决定了你是不是愿意真正把它融入开发流程。

换句话说,让 OpenClaw用上 DeepSeek,本质是在给这只龙虾“一颗适合中国开发者的脑子”。

二、接入方式全景:云端 API、本地推理与代理混合

从高层看,把DeepSeek接到 OpenClaw上大致有三条路:

- 云端API直连:最简单直接,只需要在 OpenClaw的配置里填好APIKey 和 Base URL。

- 自建代理网关:在公司或家里部署一个统一的LLM网关,由它负责转发DeepSeek请求。

- 本地推理服务:在 GPU 机器上部署DeepSeek或兼容权重,通过HTTP/ WebSocket 暴露接口给 OpenClaw。

如果你只是想先体验“OpenClaw+DeepSeek 是什么感觉”,完全可以先从第一种云端API方式开始;

等到团队认可、预算落地,再考虑用网关或本地推理把成本和稳定性做得更好。

三、配置实战:在 OpenClaw里切换到 DeepSeek

1. 修改 OpenClaw配置文件

假设你已经完成了基本的 OpenClaw中文站 指南中的安装步骤,

在本机或者服务器上能正常运行 openclaw daemon,接下来需要做的就是修改配置文件。

不同版本目录结构略有差异,但通常可以在 ~/.openclaw/ 或项目根目录下找到类似

config.yaml 或 .env 的文件。

以一种比较常见的环境变量方式为例,你需要准备以下几项:

MODEL_PROVIDER=deepseek

DEEPSEEK_API_BASE=https://api.deepseek.com/v1

DEEPSEEK_API_KEY=你的密钥

DEEPSEEK_MODEL=deepseek-chat

然后在 OpenClaw的模型选择逻辑中,将默认模型从 gpt-4.x 切换为 DEEPSEEK_MODEL,

具体写法会随版本和配置方式略有不同,但核心思路是一致的:统一改在一处,不要散落在Skills里到处写死模型名。

2. 网络与代理配置的小坑

在国内环境下,访问DeepSeekAPI 时最常见的问题有两个:

- 证书或 TLS 相关错误:检查是否用到了公司代理或自签证书,需要在Node.js层允许相应 CA。

- 间歇性超时:如果链路上有多层代理,可以在服务器端设置本地直连,避免绕太多圈。

对于已经在用 OpenClaw访问多个模型的用户,建议把DeepSeek的访问也统一纳入已有的HTTP代理或

API 网关中,这样既方便集中监控,也便于后续做限流与审计。

四、让DeepSeek真正发挥价值:几个高频场景示例

1. 代码重构与单元测试生成

很多人接入DeepSeek之后,第一件事就是让它帮忙重构旧项目。

结合 OpenClaw的文件系统技能,你可以这样设计一个简单流程:

- 让 OpenClaw扫描指定项目目录,分析最近修改较多、且缺少测试的模块。

- 调用DeepSeek生成重构建议和对应的单元测试草稿。

- 由你来做最终决策和代码合并。

这种“人机协作”的模式,比单纯在编辑器里问一句“帮我改下这个函数”更接近真实生产环境。

在实践中,你还可以把这些操作封装成一个技能,作为 OpenClaw后续自动巡检任务的一部分。

2. 复杂问题推理与日志分析

DeepSeek 在长链条推理上的表现,让它非常适合处理“多步逻辑 + 多源信息”的问题。

例如:

- 一次生产事故,涉及多个微服务、数十条日志和监控数据。

- 一段长对话,需要从中抽取用户需求、风险点和后续行动项。

让 OpenClaw帮你做的事情可以是:

- 收集各服务的核心日志片段,按时间轴拼接好。

- 组织成一份结构化的输入给 DeepSeek,让它尝试推断“最有可能的问题链路”。

- 再由你根据其推断去实地验证,形成一份真实的 Postmortem。

这样的工作流很适合放在“OpenClaw养龙虾 故障排查版”的故事里写成复盘文章,

对团队知识库和 Bing/搜索引擎来说都很有价值。

五、问答:关于 OpenClaw+DeepSeek 的几个常见问题

Q1:接入DeepSeek会影响 OpenClaw的其他技能吗?

只要你在配置层面做了合理抽象(例如统一使用 MODEL_PROVIDER 和 MODEL_NAME),

大部分技能并不关心具体模型是哪一个。真正需要留意的是:

- 不同模型对 token 上限、工具调用格式、流式返回的支持程度可能不一样。

- 如果某些技能依赖特定厂商的功能(比如OpenAI的 function calling),需要额外做兼容层。

Q2:DeepSeek 和国外模型比,最大的差异是什么?

从目前社区反馈看,最大的差异在三点:

- 中文理解与输出更自然,尤其是长文本的逻辑组织。

- 在部分代码任务上表现不输主流模型,尤其是偏工程化的改造和调试场景。

- 网络与合规环境更友好,对国内开发者来说上手门槛更低。

当然,这并不意味着你一定要在所有场景下只用 DeepSeek。更实际的做法,是让 OpenClaw

根据任务类型在多个模型之间智能选择——例如,长文本总结用一个便宜模型,复杂代码重构交给 DeepSeek。

Q3:个人开发者有没有必要折腾本地DeepSeek推理?

如果你只是想体验“OpenClaw养龙虾”的感觉,云端API已经足够。

本地推理的价值在于:当你需要大量、稳定、可控的推理能力时,

可以把成本从“每次调用付费”迁移到“付一次硬件钱长期使用”。

在真正投入时间和预算之前,建议先用一两周时间跑跑云端版本,

测一测自己实际每天用多少 token、主要在哪些场景用,

再来评估是不是值得为此准备一台专门的 GPU 机器。

六、结语:让龙虾拥有更适合中国开发者的“大脑”

OpenClaw的强大,在于它提供了一套足够灵活的“身体”和“神经系统”——

文件系统技能、浏览器自动化、聊天入口集成、上下文管理、安全策略……而 DeepSeek

这样的国产模型,则可以成为这具身体里非常适合中文场景的一颗“大脑”。

当你把两者真正打通,你会发现所谓“OpenClaw养龙虾”并不只是一个梗,

而是一个围绕本地 AI 基础设施和日常工作流重构的长期工程。

希望这篇接入实践笔记,能让你在这条路上少踩几个坑,早点养出一只真正懂你的龙虾。